近日,渊亭科技取得《一种基于分布式强化学习的多智能体机器人协同控制方法及系统》国家发明专利。该专利面向机器人控制技术领域,以更加高效、灵活且鲁棒的分布式控制策略来替代集中式控制方法,使各智能体在环境中独立学习并相互共享经验,同时降低对单一控制节点的依赖,显著提升复杂任务场景下多智能体机器人系统的整体性能与鲁棒性。

近年来,随着人工智能技术及机器人技术的迅猛发展,多智能体机器人系统因其独特的优势在多个领域如协同作业、资源优化分配以及未知环境探索中展现出前所未有的潜力和应用价值。在多智能体机器人系统的早期发展阶段,集中式控制因其显著的架构优势成为主流范式。该方法通过中央决策单元实现对群体行为的全局规划与动态调度,在系统层面确保了任务执行的强一致性和行为序列的有序性。随着系统应用场景的深化以及群体规模的数量级增长,集中式控制方法的局限性逐渐显现。

1.数据处理瓶颈

传统集中式控制依赖单一中心节点处理所有机器人的状态信息,当智能体数量增加,计算负载呈指数级上升,导致系统响应延迟、任务执行效率显著下降。

2.容错性较低

中心控制节点是整个系统的核心,一旦故障会导致全局失控,难以继续执行任务。3.动态适应能力缺乏

集中式架构下智能体之间的依赖性过强,机器人缺乏自主决策能力,难以根据实时环境灵活调整策略,导致资源分配僵化、任务冲突频发。

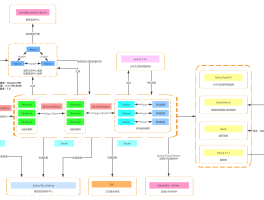

基于以上问题,渊亭科技发明了一种基于分布式强化学习的多智能体机器人协同控制方法及系统。本发明通过以下核心设计,实现多智能体协同控制优化:

基于“演员-评论家“架构,结合策略梯度和价值函数估计,为每个机器人智能体构建独立的演员网络和评论家网络,其中:

● 演员网络:根据当前机器人状态选择动作,以最大化预期回报;● 评论家网络:评估动作价值,并指导策略优化。● 在多智能体系统中,每个机器人都可以被视为一个独立的智能体,使用演员-评论家方法独立学习其策略,并通过共享观测信息或全局状态来协同工作。

● 采用模块化设计,包含采样模块、训练模块、调度管理及存储模块。

● 通过分布式训练框架,使每个节点的机器人智能体能够共享经验(采样模块的样本数据共享)和共享协作训练(训练模块的神经网络参数共享),从而实现协同控制策略,提高系统的整体性能和鲁棒性。

● 提供任务调度、分布式状态管理和高性能计算的功能,可以简化并行计算,加速模型训练,并通过分布式任务管理实现高效计算环境。

根据机器人协同控制场景构建多智能体强化学习算法环境,定义状态空间、动作空间和奖励函数:

● 状态空间:除智能体的基础属性与运动状态外,引入时序与历史状态信息,全面反映机器人团队在不同时间点的状态变化与交互历史;

● 动作空间:覆盖移动指令与操作指令,实现机器人之间的紧密协作与高效任务执行;

● 奖励函数:设计六类奖励机制(任务完成度、协同效率、资源消耗、位置/速度优化、环境感知、时序连贯性),通过动态权重调节机制实现多目标优化,引导机器人更好适应不同的任务和环境需求。

渊亭科技《一种基于分布式强化学习的多智能体机器人协同控制方法及系统》专利为多智能体机器人系统的协同控制提供了一种全新的解决方案,可广泛应用于智能制造、物流仓储、国防军事、公共服务等多个领域,推动机器人技术的进一步发展。未来,渊亭科技致力于前沿技术的研发与创新,不断探索多智能体机器人领域更多的可能性。期待这项专利技术能够在更多领域得到落地应用,推动机器人控制技术与人工智能的深度融合,为社会经济发展和科技进步贡献更多力量。

推荐站内搜索:最好用的开发软件、免费开源系统、渗透测试工具云盘下载、最新渗透测试资料、最新黑客工具下载……

还没有评论,来说两句吧...